|

基于终端的开发环境 |

可视化交互体验 |

"AI智能体将创意转化为生产就绪代码的地方"

🧭 [2026-05-01] OpenRouter 模型选择器、session 清理与工作流体验增强

- 🧠 Settings 中新增 OpenRouter 模型目录。 新版 UI 可以从

https://openrouter.ai/api/v1/models获取 OpenRouter 模型元数据,本地缓存后提供可搜索的 Default、Planning、Implementation 三阶段模型下拉框。用户可以直接选择z-ai/glm-5.1这类 OpenRouter 精确模型 id,无需手动编辑 JSON。 - 🔄 运行时模型切换。 在 Settings 保存模型选择后,会更新

deepcode_config.json并刷新进程内 LLM runtime;之后新启动的 workflow 会立即使用新的 provider/model 组合。 - 🗑️ Session 删除改为安全级联清理。 在 UI 中删除 session 时,会删除持久化 session 记录和对应的

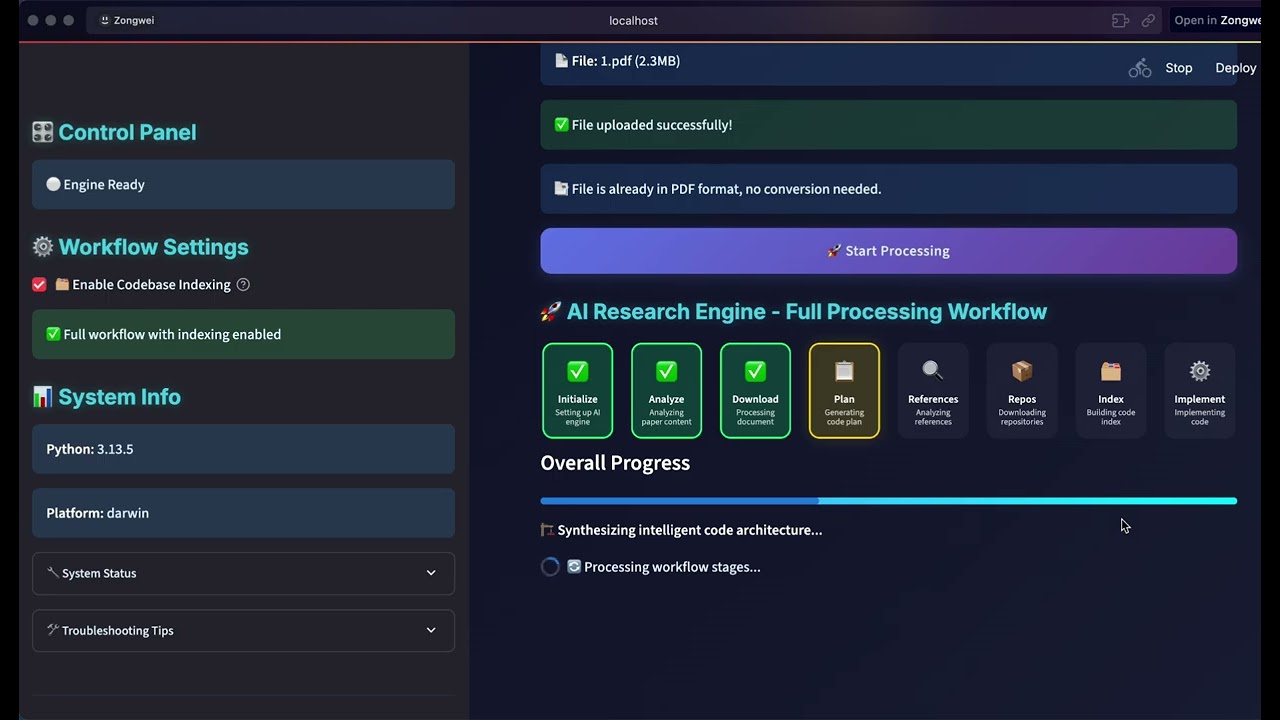

deepcode_lab/tasks/<task_id>/工作目录,但保留可被多个 session 共享的uploads/原始文件。若 session 下仍有pending、running或waiting_for_inputtask,后端会返回明确的409 Conflict。 - 📊 Paper2Code 进度显示更准确。 前端现在会展示后端阶段消息,并避免在长时间 LLM 阶段尚未完成时,把中间步骤误标记为完全 Done。

- 🛡️ 工作流稳定性修复。 上传阶段会拒绝 Git LFS pointer 文件;取消任务会及时中断后端工作;浏览器中的过期 session id 会自动恢复;planner 在模型输出错误的工具调用/延迟执行文本时会回退到最小合法 plan;文档分割阶段跳过额外质量验证 LLM 调用,减少卡在 50% 的概率。

🗂️ [2026-04-28] 持久化 session 与双层结构化日志

- 🆕 Session 现在会持久化。 每次 CLI / UI 运行都会自动挂到一个 session,默认保存在

~/.deepcode/sessions/<id>/(可用DEEPCODE_SESSIONS_DIR覆盖)。session 使用 JSONL 存储,支持python cli/main_cli.py session list|show <id>|new|resume <id>|delete <id>,后端也提供GET /api/v1/sessions。 - 🔄 恢复历史任务。 CLI 可以用

--session <id>把新任务挂到旧 session;UI / API 可以在POST /api/v1/workflows/paper-to-code或chat-planning中传session_id。后端重启后会从磁盘恢复历史 task,崩溃前仍在运行的 task 会标记为interrupted。 - 💻 CLI 交互增强。 进入

python cli/main_cli.py后,可以在主菜单输入/resume打开历史 session 选择器,/new [title]新建并切换 session,/session查看当前 session,/help查看命令。也支持 Cursor/Codex 风格的内联输入:@/path/to/paper.pdf、@"C:\path with spaces\paper.pdf"、@https://...。 - 📜 双层结构化日志。 全局日志写入

logs/server-YYYYMMDD.jsonl;每个任务的日志写入deepcode_lab/tasks/<task_id>/logs/{system,llm,mcp}.jsonl。所有loguru.logger调用都会通过 contextvar 自动带上task_id/session_id,LLM/MCP 调用还会记录耗时、token、请求/响应摘要。 - 📡 WebSocket 日志流。 单 task 日志流:

/ws/tasks/{task_id}/logs?channel=llm;按 session 聚合多个 task:/ws/sessions/{session_id}/logs。旧的假/ws/logs/{session_id}已移除。 - 🧹 清理旧实现。 删除

utils/simple_llm_logger.py、utils/dialogue_logger.py,原内存版services/session_service.py改为core.sessions.SessionStore的 thin facade。

🎉 [2026-02] DeepCode + nanobot 集成 — 通过飞书聊天使用 DeepCode!

- nanobot 现已连接到 DeepCode — 在飞书中发送消息即可自动生成代码

- 支持论文转代码和对话转代码,以及实时任务跟踪,全部在聊天应用中完成

- 一键部署:

./nanobot/run_nanobot.sh→ 设置指南 →

🎉 [2026-02] 全新 Web UI 体验升级!

- 🔄 用户交互循环 (User-in-Loop): 支持工作流程中的实时用户交互,AI 会在对话中向您提问以澄清需求

- 💬 内联交互设计: 交互问题直接显示在对话框中,体验更自然流畅

- 🚀 一键启动: 运行

deepcode即可启动新版 UI(跨平台支持:Windows/macOS/Linux) - 🔧 优化的进程管理: 改进了服务启停机制,自动清理端口占用

- 📡 WebSocket 实时通信: 修复了消息丢失问题,确保交互状态正确同步

🎉 [2025-10-28] DeepCode在PaperBench上达到最先进水平!

DeepCode在OpenAI的PaperBench Code-Dev所有类别中创造新基准:

- 🏆 超越人类专家: 75.9% (DeepCode) vs 顶级机器学习博士 72.4% (+3.5%)。

- 🥇 超越最先进商业代码智能体: 84.8% (DeepCode) vs 领先商业代码智能体 (+26.1%) (Cursor, Claude Code, 和 Codex)。

- 🔬 推进科学编程: 73.5% (DeepCode) vs PaperCoder 51.1% (+22.4%)。

- 🚀 击败LLM智能体: 73.5% (DeepCode) vs 最佳LLM框架 43.3% (+30.2%)。

|

复杂算法的自动化实现 轻松将研究论文中的复杂算法转换为高质量、生产就绪的代码,加速算法复现。 |

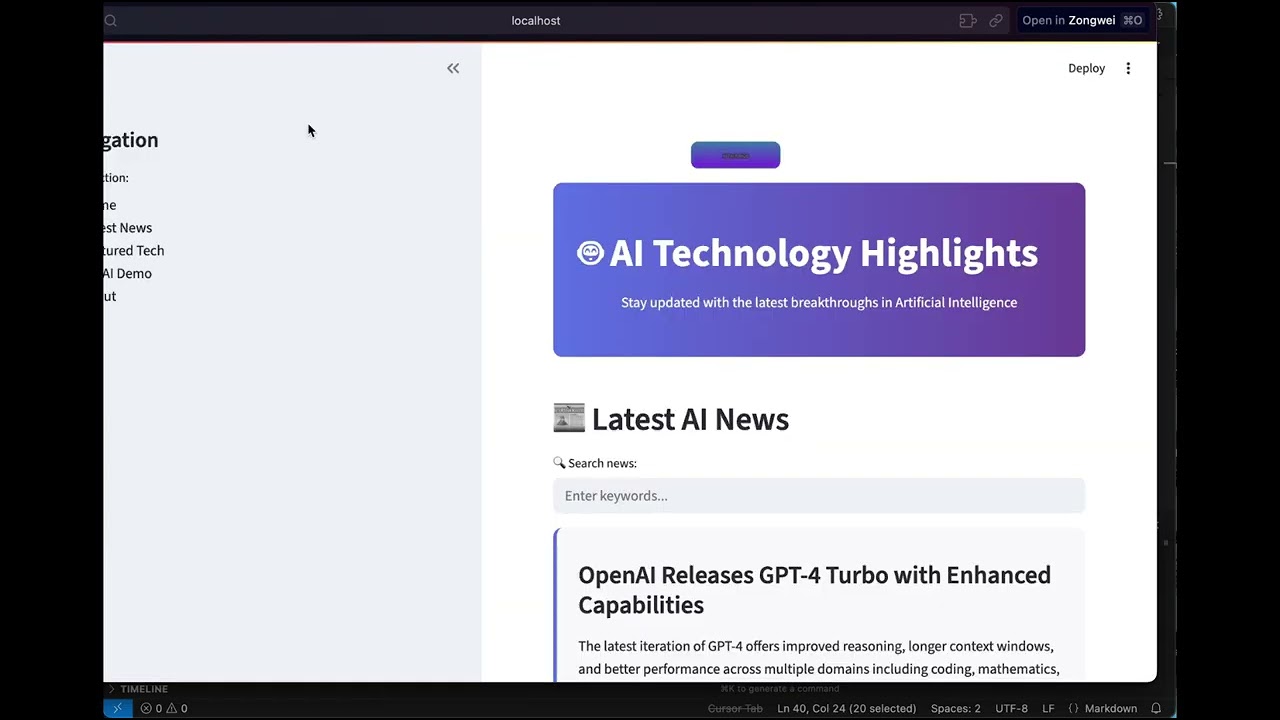

自动化前端Web开发 将纯文本描述转换为功能完整、视觉美观的前端Web代码,快速创建界面。 |

自动化后端开发 从简单的文本输入生成高效、可扩展和功能丰富的后端代码,简化服务器端开发。 |

我们在PaperBench基准测试(由OpenAI发布)上评估DeepCode,这是一个严格的测试平台,要求AI智能体从头独立复现20篇ICML 2024论文。该基准包含8,316个可评分组件,使用带有分层权重的SimpleJudge进行评估。

我们的实验将DeepCode与四个基线类别进行比较:(1) 人类专家,(2) 最先进商业代码智能体,(3) 科学代码智能体,以及 (4) 基于LLM的智能体。

DeepCode: 75.9% vs. 顶级机器学习博士: 72.4% (+3.5%)

DeepCode在3篇论文的人类评估子集上达到75.9%,超越3次人类专家基线(72.4%)+3.5个百分点。这表明我们的框架不仅匹配而且超越了专家级代码复现能力,代表了自主科学软件工程的重要里程碑。

DeepCode: 84.8% vs. 最佳商业智能体: 58.7% (+26.1%)

在5篇论文的子集上,DeepCode大幅超越领先的商业编码工具:

- Cursor: 58.4%

- Claude Code: 58.7%

- Codex: 40.0%

- DeepCode: 84.8%

这代表了相对于领先商业代码智能体的**+26.1%改进**。所有商业智能体都使用Claude Sonnet 4.5或GPT-5 Codex-high,突出了DeepCode的卓越架构——而非基础模型能力——推动了这一性能差距。

DeepCode: 73.5% vs. PaperCoder: 51.1% (+22.4%)

与最先进的科学代码复现框架PaperCoder(51.1%)相比,DeepCode达到73.5%,展示了**+22.4%的相对改进**。这一显著差距验证了我们结合规划、分层任务分解、代码生成和迭代调试的多模块架构优于简单的管道式方法。

DeepCode: 73.5% vs. 最佳LLM智能体: 43.3% (+30.2%)

DeepCode显著超越所有测试的LLM智能体:

- Claude 3.5 Sonnet + IterativeAgent: 27.5%

- o1 + IterativeAgent (36小时): 42.4%

- o1 BasicAgent: 43.3%

- DeepCode: 73.5%

相对于表现最佳的LLM智能体的**+30.2%改进**表明,复杂的智能体框架,而非延长的推理时间或更大的模型,对于复杂的代码复现任务至关重要。

面临的挑战:

-

📄 实现复杂性: 将学术论文和复杂算法转换为可运行代码需要大量技术投入和领域专业知识

-

🔬 研究瓶颈: 研究人员将宝贵时间花在算法实现上,而不是专注于核心研究和发现工作

-

⏱️ 开发延迟: 产品团队在概念和可测试原型之间经历长时间等待,减慢创新周期

-

🔄 重复编码: 开发者重复实现相似的模式和功能,而不是基于现有解决方案构建

DeepCode 通过为常见开发任务提供可靠的自动化来解决这些工作流程低效问题,简化从概念到代码的开发工作流程。

flowchart LR

A["📄 研究论文<br/>💬 文本提示<br/>🌐 URL和文档<br/>📎 文件: PDF, DOC, PPTX, TXT, HTML"] --> B["🧠 DeepCode<br/>多智能体引擎"]

B --> C["🚀 算法实现 <br/>🎨 前端开发 <br/>⚙️ 后端开发"]

style A fill:#ff6b6b,stroke:#c0392b,stroke-width:2px,color:#000

style B fill:#00d4ff,stroke:#0984e3,stroke-width:3px,color:#000

style C fill:#00b894,stroke:#00a085,stroke-width:2px,color:#000

DeepCode 是一个AI驱动的开发平台,自动化代码生成和实现任务。我们的多智能体系统处理将需求转换为功能性、结构良好代码的复杂性,让您专注于创新而非实现细节。

🎯 技术能力:

🧬 研究到生产流水线

多模态文档分析引擎,从学术论文中提取算法逻辑和数学模型。生成优化的实现,使用适当的数据结构,同时保持计算复杂度特征。

🪄 自然语言代码合成

使用在精选代码库上训练的微调语言模型进行上下文感知代码生成。在支持多种编程语言和框架的同时保持模块间架构一致性。

⚡ 自动化原型引擎

智能脚手架系统,生成包括数据库模式、API端点和前端组件的完整应用程序结构。使用依赖分析确保从初始生成开始的可扩展架构。

💎 质量保证自动化

集成静态分析与自动化单元测试生成和文档合成。采用AST分析进行代码正确性检查和基于属性的测试进行全面覆盖。

🔮 CodeRAG集成系统

高级检索增强生成,结合语义向量嵌入和基于图的依赖分析。从大规模代码语料库中自动发现最优库和实现模式。

-

🧠 智能编排智能体: 协调工作流阶段和分析需求的中央决策系统。采用动态规划算法,根据不断发展的项目复杂性实时调整执行策略。为每个实现步骤动态选择最优处理策略。

-

💾 高效内存机制: 高效管理大规模代码上下文的高级上下文工程系统。实现分层内存结构,具有智能压缩功能,用于处理复杂代码库。该组件实现实现模式的即时检索,并在扩展开发会话中保持语义一致性。

-

🔍 高级CodeRAG系统: 分析跨存储库复杂相互依赖关系的全局代码理解引擎。执行跨代码库关系映射,从整体角度理解架构模式。该模块利用依赖图和语义分析在实现过程中提供全局感知的代码建议。

-

🎯 中央编排智能体: 编排整个工作流程执行并做出战略决策。基于输入复杂性分析协调专门智能体。实现动态任务规划和资源分配算法。

-

📝 意图理解智能体: 对用户需求进行深度语义分析以解码复杂意图。通过高级NLP处理提取功能规范和技术约束。通过结构化任务分解将模糊的人类描述转换为精确、可操作的开发规范。

-

📄 文档解析智能体: 使用高级解析能力处理复杂的技术文档和研究论文。使用文档理解模型提取算法和方法。通过智能内容分析将学术概念转换为实用的实现规范。

-

🏗️ 代码规划智能体: 执行架构设计和技术栈优化。动态规划适应性开发路线图。通过自动化设计模式选择执行编码标准并生成模块化结构。

-

🔍 代码参考挖掘智能体: 通过智能搜索算法发现相关存储库和框架。分析代码库的兼容性和集成潜力。基于相似性度量和自动化依赖分析提供建议。

-

📚 代码索引智能体: 构建发现代码库的综合知识图谱。维护代码组件之间的语义关系。实现智能检索和交叉引用能力。

-

🧬 代码生成智能体: 将收集的信息合成为可执行的代码实现。创建功能接口并集成发现的组件。生成全面的测试套件和文档以确保可重现性。

🔧 基于MCP (模型上下文协议) 驱动

DeepCode利用模型上下文协议 (MCP) 标准与各种工具和服务无缝集成。这种标准化方法确保AI智能体和外部系统之间的可靠通信,实现强大的自动化能力。

| 🛠️ MCP服务器 | 🔧 主要功能 | 💡 目的和能力 |

|---|---|---|

| 📂 filesystem | 文件系统操作 | 本地文件和目录管理,读/写操作 |

| 🌐 fetch | Web内容检索 | 从URL和Web资源获取和提取内容 |

| 📥 github-downloader | 存储库管理 | 克隆和下载GitHub存储库进行分析 |

| 📋 file-downloader | 文档处理 | 下载文件(PDF、DOCX等)并转换为Markdown |

| ⚡ command-executor | 系统命令 | 执行bash/shell命令进行环境管理 |

| 🧬 code-implementation | 代码生成中心 | 具有执行和测试的综合代码复现 |

| 📚 code-reference-indexer | 智能代码搜索 | 代码存储库的智能索引和搜索 |

| 📄 document-segmentation | 智能文档分析 | 大型论文和技术文档的智能文档分割 |

| 🛠️ 功能 | 🎯 使用上下文 |

|---|---|

| 📄 read_code_mem | 从内存高效检索代码上下文 |

| ✍️ write_file | 直接文件内容生成和修改 |

| 🐍 execute_python | Python代码测试和验证 |

| 📁 get_file_structure | 项目结构分析和组织 |

| ⚙️ set_workspace | 动态工作空间和环境配置 |

| 📊 get_operation_history | 过程监控和操作跟踪 |

🎛️ 多界面框架

具有CLI和Web前端的RESTful API,具有实时代码流、交互式调试和可扩展插件架构,用于CI/CD集成。

🚀 多智能体智能流水线:

|

💡 输入层 📄 研究论文 • 💬 自然语言 • 🌐 URL • 📋 需求 |

||

|

🎯 中央编排 战略决策制定 • 工作流程协调 • 智能体管理 |

||

|

📝 文本分析 需求处理 |

📄 文档分析 论文和规范处理 |

|

|

📋 复现规划 深度论文分析 • 代码需求解析 • 复现策略开发 |

||

|

🔍 参考分析 存储库发现 |

📚 代码索引 知识图谱构建 |

|

|

🧬 代码实现 实现生成 • 测试 • 文档 |

||

|

⚡ 输出交付 📦 完整代码库 • 🧪 测试套件 • 📚 文档 • 🚀 部署就绪 |

||

在安装 DeepCode 之前,请确保您已安装以下软件:

| 要求 | 版本 | 用途 |

|---|---|---|

| Python | 3.9+ | 核心运行环境 |

| Node.js | 18+ | 新版 UI 前端 |

| npm | 8+ | 包管理工具 |

# 检查您的版本

python --version # 应为 3.9+

node --version # 应为 18+

npm --version # 应为 8+📥 安装 Node.js(如果未安装)

# macOS (使用 Homebrew)

brew install node

# Ubuntu/Debian

curl -fsSL https://deb.nodesource.com/setup_20.x | sudo -E bash -

sudo apt-get install -y nodejs

# Windows

# 从 https://nodejs.org/ 下载安装选择以下任一安装方式:

# 🚀 直接安装 DeepCode 包

pip install deepcode-hku

# 🔑 下载统一配置模板

curl -O https://raw.githubusercontent.com/HKUDS/DeepCode/main/deepcode_config.json.example

cp deepcode_config.json.example deepcode_config.json📂 点击展开开发安装选项

git clone https://github.com/HKUDS/DeepCode.git

cd DeepCode/

curl -LsSf https://astral.sh/uv/install.sh | sh

uv venv --python=3.13

source .venv/bin/activate # Windows下: .venv\Scripts\activate

uv pip install -r requirements.txt

# 安装前端依赖

npm install --prefix new_ui/frontendgit clone https://github.com/HKUDS/DeepCode.git

cd DeepCode/

pip install -r requirements.txt

# 安装前端依赖

npm install --prefix new_ui/frontend以下配置适用于所有安装方式(pip、UV、源码安装和 Docker 均通用)。所有设置统一收敛在一个文件中:

deepcode_config.json(参考 nanobot 设计)。

编辑 deepcode_config.json,至少填入一个 provider 的 apiKey。可以直接写入字符串,也可以使用 ${ENV_VAR} 引用环境变量,加载时自动解析。

{

"providers": {

"openai": { "apiKey": "your_openai_api_key" },

"anthropic": { "apiKey": "${ANTHROPIC_API_KEY}" },

"gemini": { "apiKey": "" }

}

}DeepCode 会根据 model 前缀(例如 openai/...、anthropic/...、gemini/...)自动识别后端。如需强制指定:

{

"agents": {

"defaults": { "provider": "openai" }

}

}不同阶段可以单独覆盖模型:

{

"agents": {

"defaults": { "provider": "openrouter", "model": "z-ai/glm-5.1" },

"planning": { "provider": "openrouter", "model": "z-ai/glm-5.1" },

"implementation": { "provider": "openrouter", "model": "z-ai/glm-5.1" }

},

"providers": {

"openrouter": { "apiKey": "your_openrouter_key", "apiBase": "https://openrouter.ai/api/v1" }

}

}OpenRouter 模型必须使用 OpenRouter 官方模型目录返回的精确 id,例如

z-ai/glm-5.1、anthropic/claude-sonnet-4.5 或

google/gemini-2.5-pro。在新版 UI 中,可以打开 Settings → OpenRouter

Models 搜索实时模型目录,并分别更新 Default、Planning、Implementation

模型。保存后会刷新 runtime,之后新启动的 workflow 会使用新的模型配置。

{

"documentSegmentation": {

"enabled": true,

"sizeThresholdChars": 50000

}

}🪟 Windows 用户: 额外的 MCP 服务器配置

如果您使用 Windows,可能需要在 deepcode_config.json 的 tools.mcpServers 中手动配置 MCP 服务器:

# 1. 全局安装 MCP 服务器

npm i -g @modelcontextprotocol/server-filesystem

# 2. 找到您的全局 node_modules 路径

npm -g root{

"tools": {

"mcpServers": {

"filesystem": {

"type": "stdio",

"command": "node",

"args": ["C:/Program Files/nodejs/node_modules/@modelcontextprotocol/server-filesystem/dist/index.js", "."]

}

}

}

}注意: 将路径替换为步骤 2 中您实际的全局 node_modules 路径。

🔍 网页搜索配置

DeepCode 通过内置的 fetch MCP 服务器(无需 API key)抓取网页内容,并通过 filesystem 读取本地文件。辅助搜索服务器默认使用 filesystem:

{

"tools": { "defaultSearchServer": "filesystem" }

}💡 提示: 若要接入其他搜索后端,在

deepcode_config.json的tools.mcpServers下新增条目,并把tools.defaultSearchServer改成对应名称即可。

选择您偏好的启动方式:

| 🐳 Docker (推荐) | 🚀 本地 — 不使用 Docker | 🛠️ 其他方式 |

|---|---|---|

|

无需 Python/Node — 一切在容器内。 git clone https://github.com/HKUDS/DeepCode.git

cd DeepCode/

cp deepcode_config.json.example \

deepcode_config.json

# 编辑 deepcode_config.json 填入 API Key

./deepcode_docker/run_docker.sh

# 访问 → http://localhost:8000 |

直接在宿主机运行新版 UI(前端 + 后端,不使用容器)。 deepcode --local

# 前端 → http://localhost:5173

# 后端 → http://localhost:8000

# Ctrl+C 停止特性:用户交互循环、实时进度、内联对话。

|

# macOS / Linux

./run.sh

# 或: python deepcode.py --local

# Windows

run.bat

# 或: python deepcode.py --local

# 经典 Streamlit UI

deepcode --classic

# CLI 模式

deepcode --cli

# 或: python cli/main_cli.py |

CLI 默认带 session。没有传 --session 时会自动创建新 session,并保存在

~/.deepcode/sessions/<id>/;传 --session <id> 时,新 task 会追加到已有

session。

# 在 shell 中管理 session

python cli/main_cli.py session list

python cli/main_cli.py session show <session_id>

python cli/main_cli.py session resume <session_id> # 显示历史后进入交互模式

python cli/main_cli.py --session <session_id> --file paper.pdf进入 python cli/main_cli.py 后,可以在主菜单直接输入:

/resume # 从编号列表中选择历史 session

/new 我的实验 # 新建并切换到一个 session

/session # 显示当前活跃 session

@/absolute/path.pdf # 不弹文件选择框,直接处理文件

@"C:\path with spaces\paper.pdf"

@https://arxiv.org/pdf/....

这些入口创建的 task 都会继承当前 session_id;per-task 日志会写入

deepcode_lab/tasks/<task>/logs/。

在 Web UI 中,可以通过顶部 Sessions 菜单恢复或删除 session。删除

session 会移除 JSONL session 记录和对应的 deepcode_lab/tasks/ 工作目录,

但不会删除 uploads/ 中的原始上传文件。如果该 session 仍有 pending、

running 或 waiting_for_input task,后端会拒绝删除,直到任务被取消或完成。

🐳 Docker 管理命令

./deepcode_docker/run_docker.sh stop # 停止

./deepcode_docker/run_docker.sh restart # 重启(配置更改无需重建)

./deepcode_docker/run_docker.sh --build # 强制重建

./deepcode_docker/run_docker.sh logs # 实时日志

./deepcode_docker/run_docker.sh status # 健康检查

./deepcode_docker/run_docker.sh clean # 删除容器和镜像或直接使用 Docker Compose:

docker compose -f deepcode_docker/docker-compose.yml up --build # 构建并启动

docker compose -f deepcode_docker/docker-compose.yml down # 停止

docker compose -f deepcode_docker/docker-compose.yml logs -f # 查看日志💡 配置文件以卷方式挂载 — 编辑后重启即可,无需重建。 💡 Windows 用户:如果脚本不可用,可直接运行

docker compose命令。

- 📄 输入 — 上传研究论文、输入需求,或粘贴 URL

- 🤖 处理 — 多智能体系统分析、规划并生成

- ⚡ 输出 — 接收带测试和文档的生产就绪代码

❓ 常见问题与解决方案

| 问题 | 原因 | 解决方案 |

|---|---|---|

Docker 构建失败 tsc: not found |

构建缓存损坏 | docker builder prune -f 然后用 --no-cache 重建 |

error during connect / cannot find the file |

Docker Desktop 未运行 | 启动 Docker Desktop,等待就绪后重试 |

| 前端空白页面 | node_modules 损坏 |

cd new_ui/frontend && rm -rf node_modules && npm install |

ERR_CONNECTION_REFUSED |

端口错误/后端未运行 | Docker: http://localhost:8000。本地: http://localhost:5173 |

npm install → Could not read package.json |

目录错误 | 使用 npm install --prefix new_ui/frontend |

| Windows: MCP 服务器无法工作 | 需要绝对路径 | 参见上方 Windows MCP 配置 |

直接在飞书中使用 DeepCode — 发送消息,获取代码!

nanobot 是一个超轻量级 AI 助手,现已与 DeepCode 深度集成。通过飞书聊天,您可以:

- 🚀 提交论文转代码任务(

paper2code)— 粘贴 arXiv 链接即可 - 💬 启动对话转代码(

chat2code)— 用自然语言描述需求 - 📊 实时查询任务状态(

deepcode_status)— 获取进度和结果 - ✅ 响应 DeepCode 交互提示 — 当 AI 需要澄清需求时直接在聊天中回答

flowchart TB

subgraph ChatPlatforms[💬 聊天平台]

Feishu[<b>飞书</b><br/>📱 当前支持]

Telegram[Telegram<br/>🔜 即将支持]

Discord[Discord<br/>🔜 即将支持]

end

subgraph NanobotCore[🤖 Nanobot 核心]

LLM[LLM 推理引擎<br/>Claude / GPT / Minimax]

Tools[工具层<br/>web_fetch / code_executor / deepcode]

end

subgraph DeepCodeEngine[⚡ DeepCode 引擎]

API[HTTP API<br/>任务提交 & 查询]

Agents[多智能体系统<br/>规划 / 分析 / 生成]

Output[代码输出<br/>测试 + 文档]

end

Feishu -->|WebSocket| NanobotCore

Telegram -.->|未来集成| NanobotCore

Discord -.->|未来集成| NanobotCore

NanobotCore -->|调用 deepcode_* 工具| DeepCodeEngine

DeepCodeEngine -->|返回结果 & 进度| NanobotCore

NanobotCore -->|推送消息| Feishu

style Feishu fill:#0EA5E9,stroke:#0284c7,stroke-width:3px,color:#fff

style NanobotCore fill:#8b5cf6,stroke:#7c3aed,stroke-width:2px,color:#fff

style DeepCodeEngine fill:#10b981,stroke:#059669,stroke-width:2px,color:#fff

style Telegram fill:#d1d5db,stroke:#9ca3af,stroke-width:1px,color:#4b5563,stroke-dasharray: 5 5

style Discord fill:#d1d5db,stroke:#9ca3af,stroke-width:1px,color:#4b5563,stroke-dasharray: 5 5

🎯 当前支持: 飞书(Feishu / Lark) 🔮 架构预留: Telegram 和 Discord 节点为未来扩展保留

- ✅ DeepCode 后端正在运行(见上方 快速开始)

- ✅ 飞书企业应用(或租用应用)— 免费创建

- ✅ LLM API 密钥(OpenRouter / Claude / Minimax)

📱 点击展开飞书应用创建步骤

- 登录 飞书开放平台

- 点击 创建企业自建应用

- 填写应用名称和描述,上传图标

- 进入 凭证与基础信息 页面,复制:

App IDApp Secret

- 进入 事件订阅 页面:

- 请求地址 URL:

http://your-server-ip:8081/feishu/event(公网可访问) - 消息加密: 复制

Encrypt Key和Verification Token

- 请求地址 URL:

- 进入 权限管理,开通以下权限:

im:message(接收消息)im:message:send_as_bot(发送消息)im:chat(获取群信息)

- 发布版本 → 等待管理员审核通过

💡 开发环境: 可使用 ngrok 或 localhost.run 将本地 8081 端口映射到公网。

编辑项目根目录的 nanobot_config.json:

{

"channels": [

{

"type": "feishu",

"app_id": "cli_xxxxxxxxxxxxx",

"app_secret": "your_app_secret",

"encrypt_key": "your_encrypt_key",

"verification_token": "your_verification_token"

}

],

"llm": {

"provider": "openai", // 或 "anthropic" / "minimax"

"model": "openai/gpt-4o", // 推荐英文模型

"api_key": "your_api_key",

"base_url": "https://openrouter.ai/api/v1" // 可选

},

"deepcode": {

"api_url": "http://localhost:8000" // DeepCode 后端地址

}

}💡 提示: 使用

nanobot_config.json.example作为模板。

确保 DeepCode 后端已运行,然后启动 nanobot:

cd DeepCode/

./nanobot/run_nanobot.shDocker Compose 模式 (同时启动 DeepCode + nanobot):

docker compose -f deepcode_docker/docker-compose.yml up -d访问飞书,找到你的机器人,发送消息测试:

hi

如果收到回复,说明配置成功!🎉

| 操作 | 命令示例 |

|---|---|

| 论文转代码 | paper2code https://arxiv.org/abs/2104.09864 |

| 对话转代码 | chat2code 实现一个计算斐波那契数列的 Python 函数 |

| 查询任务状态 | deepcode_status task_abc123 |

| 响应交互 | 当 AI 询问"需要测试用例吗?"时直接回复 是 或 否 |

🛠️ nanobot 管理命令

# 查看日志(Docker 模式)

docker compose -f deepcode_docker/docker-compose.yml logs -f nanobot

# 重启 nanobot(Docker 模式)

docker compose -f deepcode_docker/docker-compose.yml restart nanobot

# 停止所有服务(Docker 模式)

docker compose -f deepcode_docker/docker-compose.yml down🔧 常见问题(nanobot)

| 问题 | 解决方案 |

|---|---|

| nanobot 响应为中文 | 修改 nanobot_config.json 中 llm.model 为英文模型(如 gpt-4o) |

| 飞书收不到消息 | 检查事件订阅 URL 是否可公网访问,端口 8081 是否开放 |

| DeepCode 任务提交失败 | 确认 deepcode.api_url 正确,后端正在运行 |

| nanobot 容器无法启动 | 检查 nanobot_config.json 格式是否正确(使用 JSON 验证器) |

|

研究到实现 |

AI驱动的图像工具 |

完整Web应用程序 |

- 智能处理: 自动处理超出LLM令牌限制的大型研究论文和技术文档

- 可配置控制: 通过配置切换分割功能,具有基于大小的阈值

- 语义分析: 高级内容理解,保留算法、概念和公式

- 向后兼容: 对较小文档无缝回退到传统处理

我们正在不断增强DeepCode的令人兴奋的新功能:

- 自动化测试: 具有执行验证和错误检测的全面功能测试。

- 代码质量保证: 通过静态分析、动态测试和性能基准测试进行多级验证。

- 智能调试: AI驱动的错误检测,具有自动纠正建议

- 基准仪表板: PaperBench评估套件的综合性能指标。

- 准确性指标: 与最先进的论文复现系统的详细比较。

- 成功分析: 跨论文类别和复杂度水平的统计分析。

- 性能提升: 多线程处理和优化智能体协调,实现更快的生成。

- 增强推理: 具有改进上下文理解的高级推理能力。

- 扩展支持: 扩展与其他编程语言和框架的兼容性。